Военный ИИ: кто отказался от «правил игры»

На саммите REAIM в Ла-Корунье из 85 стран только 35 согласились подписать декларацию об ответственном использовании военного ИИ. США и Китай — среди отказавшихся.

Что предлагали подписать:

Признать приоритет человеческого контроля над системами с ИИ.

Ввести обязательную оценку рисков и тестирование боевых алгоритмов до развертывания.

Повысить прозрачность национальных механизмов надзора (настолько, насколько это «совместимо с безопасностью»).

Зафиксировать политическое обещание не пускать ИИ «на самотёк» в военном контуре.

Почему это важно:

Документ даже не юридически обязывающий — это всего лишь политический сигнал.

Но если даже на такой мягкий вариант не идут Вашингтон и Пекин, это показывает, насколько глубока недоверие и насколько сильна ставка на гонку военного ИИ.

По сути, мы видим зарождение «ядерной логики» в новой сфере: каждый боится проиграть, если первым начнёт себя ограничивать.

Что это значит дальше:

Без США и Китая любые «правила для военного ИИ» остаются клубом единомышленников среднего веса.

Окно для глобального режима контроля над военным ИИ быстро закрывается — технологии развиваются быстрее, чем успевают договориться дипломаты.

Чем дольше нет общих рамок, тем выше риск, что первые серьёзные инциденты с ИИ на войне станут не поводом для договорённостей, а триггером эскалации.

Нужно ли вообще пытаться повторить «ядерную модель» контроля уже сейчас, пока ИИ-системы ещё относительно примитивны — или большие державы договорятся только «после первого удара»?

![Журналист: «Существует ли временное соглашение с Россией о соблюдении условий договора СНВ-III, пока идут переговоры [о новом соглашении по стратегическим вооружениям]?»](https://newstver.ru/img/20260205/14200f39e2c2ad29f84cdcf06a60a27c_290x290.jpg)

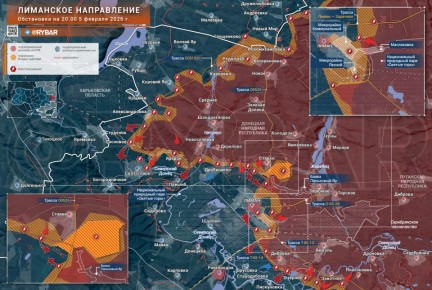

![Журналист: «Существует ли временное соглашение с Россией о соблюдении условий договора СНВ-III, пока идут переговоры [о новом соглашении по стратегическим вооружениям]?»](https://newstver.ru/img/20260205/4f64ef551549c80beba523b60155ac7b.jpg)