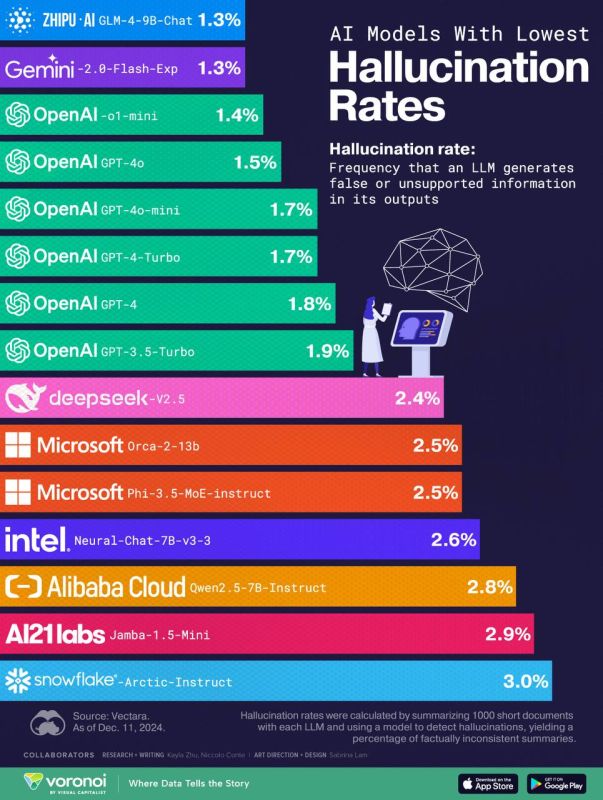

Галлюцинации искусственного интеллекта — одна из самых распространенных проблем новых генеративных нейросетей.

Под галлюцинациями подразумеваются генерируемые ИИ результаты, у которых нет никакой реальной основы. Они довольно разнообразны — от небольших ошибок до пластов странной/выдуманной информации.

Частота галлюцинаций — это периодичность, с которой нейросети генерирует ложную/неподтвержденную информацию.

Измерение частоты галлюцинаций становится все более важным — ИИ используется в медицине, юриспруденции, финансах.

Меньшие или узконаправленные ИИ-модели вроде китайской Zhipu AI GLM-4-9B-Chat, американских OpenAI-o1-mini и OpenAI-4o-mini — с одними из самых низких показателей галлюцинаций среди остальных моделей.

С точки зрения базовых моделей Gemini 2.0 от Google немного превосходит OpenAI GPT-4 — разница в частоте галлюцинаций составляет всего 0,2%.